導入人工智慧的五項組織挑戰 - 無法說Why的問題

本文延續之前康斯坦丁·霍普夫博士等人的研究,該研究談及了〈AI的組織導入:工藝與機械工作〉(Organizational Implementation of AI: Craft and Mechanical Work)中提出的五項組織挑戰。本文專注於這些挑戰中的第四項,即「無法說Why的問題」。

該研究指出,決策者通常希望了解AI系統做出特定預測的方法和原因。例如,他們想知道客戶行為的驅動因素、機器故障的原因,或者為什麼機器學習模型在實驗室測試中表現優秀,但在實際應用中表現不佳。

這種對AI運作方式的企圖了解的需求通常被稱為「可解釋性」。特別是在接受過工程或科學訓練的決策者,他們要求機器學習系統的輸出過程能夠被人類理解。畢竟,實施AI的主要目的之一是促使更具理性和基於證據的決策過程。

然而,最佳的預測模型通常是「黑盒模型」(Black Box Models),內部的參數可能高達數百萬,這些參數共同定義了將輸入轉換為輸出的函數。即使對於專家來說,理解和解釋這些模型是如何進行預測,幾乎是不可能的。換句話說,許多AI系統能夠提供卓越的預測能力,但專家卻無法解釋其預測背後的原因和方式。

霍普夫博士等人引用了一家保險公司的資料科學家的話,解釋了管理階層企圖理解機器學習模型生成的需求:「我們無法向保險經理人提供黑盒預測模型,……,經理人需要知道哪些原因對結果造成影響。」同時,霍普夫博士等人還提到,這一觀點得到了許多行業受訪者的認同。當談到透過AI支援知識工作者的決策過程時,一位受訪者指出:「『可解釋性』是使用者是否接受演算法決策建議的最重要標準。」

此外,在進行AI建模時,還必須考慮到另一個關鍵問題,即相關性和因果性之間的差異。當AI系統做出決策,並將這些決策轉化為現實行動時,必須識別出模式是否真正具有因果關係,而非偽相關性。因為根據偽相關性做決策存在著很大的風險。

該研究提出了三種策略,以解決上述問題:

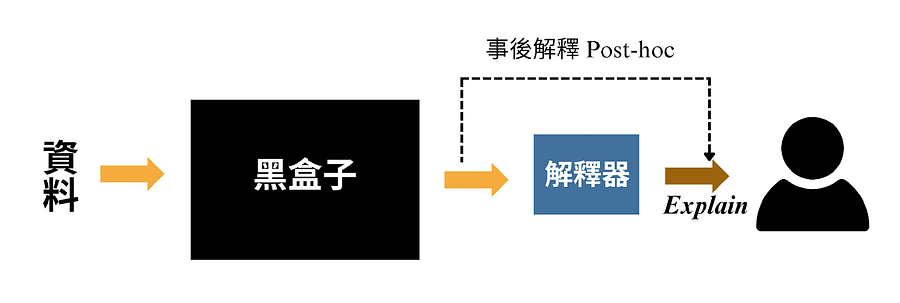

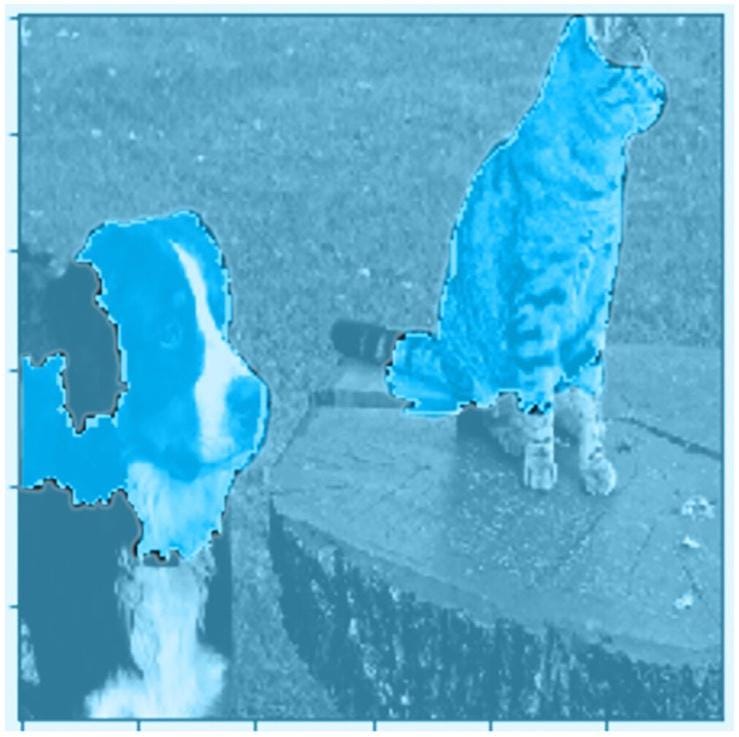

首先,他們提倡事後解釋性方法(Post-hoc explainability methods)。這種方法的目標是解釋黑盒模型背後的邏輯。它試圖將現代機器學習算法的預測準確性與經典統計模型的可解釋性相結合,期望在複雜的黑盒模型上建立可解釋的模型(如圖1、圖2所示)。然而,這樣的方法仍在積極研發中。

其次,他們強調最大程度地發揮可解釋模型(Transparent Models)的優勢。在高度專業化的領域,我們可以建立本質上可解釋模型,同時保持與黑盒模型相當的預測精度。儘管調整這些模型可能需要額外的時間和成本,但它們避免了在高風險決策問題中依賴黑盒或事後不忠實的解釋。

最後,他們提出了因果建模和嚴格的實驗評估。在因果推論的科學標準下,進行隨機對照實驗是理想的方法,許多公司也大量進行A/B測試。然而,在許多情況下,隨機對照實驗未必可行。在這種情況下,盡可能詳細地建構模型背後的因果過程,並使用適當的統計方法和工具來控制干擾因素。同時,與領域專家緊密合作,借助他們對業務問題的深入了解,以獲得準確且具有洞察力的分析結果。

作者:羅凱揚(台科大企管博士)、黃揚博(政大企管碩士、識商創辦人)

資料來源:Hopf, K., Müller, O., Shollo, A., & Thiess, T. (2023). Organizational Implementation of AI: Craft and Mechanical Work. California Management Review, 66(1), 23–47.

圖片來源:M. T. Ribeiro, S. Singh, and C. Guestrin, “‘Why Should I Trust You?’ Explaining the Predictions of Any Classifier,” (Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining, 2016), doi:10.1145/2939672.2939778.

更多商普好文推薦

有目的搜尋或無目的閒逛時,會被何種推薦所吸引?

有目的搜尋或無目的閒逛時,會被何種推薦所吸引? 越來越多的網站利用人工智慧的技術來分析消費者需求,讓網頁呈現的內容幾乎都符合使用者的興趣,這